Entdecke neue SEO-Potenziale mit der Logfile-Analyse

Die Logfile-Analyse ist ein oft unterschätzter, aber wertvoller Baustein der SEO‑Strategie. Webseiten generieren jeden Tag große Mengen an Server Logs – digitale Protokolle, die festhalten, welche Systeme welche URLs wann und wie gecrawlt haben. Für SEOs bieten diese Log-Dateien tiefe Einblicke in das Crawl‑Verhalten von Google & Co., in die Indexierungsprozesse und decken mögliche technische Probleme auf.

Das Wichtigste zur Logfile-Analyse auf einen Blick

Logfiles zeigen deine Website-Zugriffe: Du siehst, welche URLs der Google Bot, KI-Crawler und andere wirklich aufrufen (inklusive Zeitpunkt, Status Codes und teils Antwortzeiten) – unabhängig von deinem Website Tracking. Das macht SEO-Entscheidungen belastbarer, weil sie auf realem Crawl-Verhalten basieren.

Aus Logs werden priorisierte SEO-Maßnahmen: Logfiles machen sichtbar, wo Crawl-Budget verloren geht, welche Seiten zu selten oder zu oft gecrawlt werden und wo technische Hürden, Redirect-Ketten, Performance-Bremsen auftreten.

Datenqualität entscheidet über den Nutzen: Für aussagekräftige Analysen braucht es Rohdaten im geeigneten Format (z. B. CSV oder .gz/Logfiles) und alle relevanten Quellen (Server und ggf. CDN/Proxy). Wichtig sind unter anderem Timestamp (mit Zeitzone), URL inklusive Query String, Status Code, User-Agent, IP und Host/Domain.

Echten Google Bot sicher erkennen: Verlasse dich nicht nur auf den User Agent. Fake Bots verfälschen die Auswertung. Mit Reverse- und Forward-DNS-Checks lässt sich der Google Bot valide bestätigen und die Analyse bleibt sauber.

Was ist eine Logfile‑Analyse?

Wie komme ich an Server Logfiles?

Datenschutz & Logfiles

Welche Datenfelder sind für SEO wichtig?

Wie erkenne und validiere ich Google Bot?

Wofür ist Logfile-Analyse im SEO gut?

Praxis: Wann und wie wir Logfile-Analysen in der SEO durchführen

Häufige Fragen zur Logfile-Analyse

Was ist eine Logfile‑Analyse?

Die Logfile-Analyse bezeichnet die Auslesung, Aggregation und Auswertung von Server‑Log-Dateien (Access Logs). Sie zeigt dir, wann und wie deine Website aufgerufen wurde – von Nutzenden im Browser und durch automatisierte Systeme wie Suchmaschinen-Crawler. Anders als klassische Analytics Tools liefert die Analyse Logfiles roh und unbeeinflusst von Tracking‑Skripten.

Was enthält ein Server‑Logfile überhaupt?

Access Logfiles zeigen unter anderem:

Zeitpunkt der Anfrage

Zeitpunkt der Anfrage

Angeforderte URL

IP‑Adresse

HTTP Status Codes

Referrer

Wie komme ich an Server Logfiles? (Hosting/CDN/IT)

Damit eine Logfile-Analyse überhaupt möglich wird, müssen die Logfiles verfügbar sein:

1. Hosting Provider/Server

Viele Hosting Provider stellen Zugriff per FTP/SSH oder Webinterface zur Verfügung. Tipp: Frage gezielt nach dem Download der Access Logs; manche Provider legen sie nur zeitlich befristet ab.

2. CDN/Proxy

Content Delivery Networks (wie Cloudflare) führen eigene Logs. Diese können separat exportiert werden.

3. IT & Infrastruktur

Bei komplexen Architekturen (Load Balancer, Reverse Proxies) müssen verschiedene Logs zusammengeführt werden. Hier ist eine enge Abstimmung mit der IT‑Abteilung nötig. Damit die spätere Analyse effizient und aussagekräftig ist, sollten die Logfiles vollständig und im passenden Format bereitgestellt werden – idealerweise als Rohdaten (z. B. CSV oder komprimierte Textfiles wie .gz) und inklusive aller relevanten Quellen wie CDN-/Proxy-Logs. So lassen sich die Daten sauber zusammenführen und strukturiert auswerten. Damit du die Daten für eine Logfile-Analyse nutzen kannst, solltest du den Hosting-/CDN-/IT-Verantwortlichen diese Punkte mitgeben:

Zeitraum: (z. B. letzte 30/60/90 Tage) und ggf. wichtige Ereignisse im Zeitraum (Relaunch, Kampagnen, Deployments)

Quelle/System: Idealerweise Access-Logs vom Origin-Server und – falls vorhanden – zusätzlich Logs vom CDN/Proxy/Load Balancer.

Hosts/Domains: alle relevanten Hosts (z. B. www/non-www, Subdomains) und ggf. getrennte Logs für http/https.

Rohdaten + Format: unaggregierte, zeilenbasierte Roh-Access-Logs

Inhaltlich sollten mindestens diese Felder enthalten sein: Timestamp (inkl. Zeitzone), HTTP-Methode, URL inkl. Query-String, Statuscode, User-Agent, IP, Host/Domain

Datenschutz und Logfiles

In Deutschland und der EU gelten IP-Adressen als personenbezogene Daten, wenn sie auf Einzelpersonen rückführbar sind. Daher ist es wichtig, bei der Verarbeitung von Logfiles sicherzustellen, dass:

die Speicherung zeitlich begrenzt erfolgt (z. B. 7 oder 30 Tage)

Zugriffsrechte und technische Schutzmaßnahmen bestehen

ggf. eine Anonymisierung oder Pseudonymisierung der IPs erfolgt

Wichtig: Für Unternehmen ist zudem zu beachten, dass bei der Nutzung externer Tools oder Serveranbieter Auftragsverarbeitungsverträge (AVV) nach Art. 28 DSGVO abgeschlossen werden müssen. Dabei muss die Speicherung von Logfiles in der Datenschutzerklärung der Website festgelegt sein.

Welche Datenfelder sind für SEO wichtig?

In einer Logfile-Auswertung fokussieren wir uns auf folgende Felder:

| Feld | Bedeutung für SEO |

| User Agent | Identifikation von Google Bot und anderen Crawlern |

| Status Code | 200/3xx/4xx/5xx zeigen Indexierungs- und Fehlerbilder |

| Zeitpunkt | Crawl-Zeitfenster, Crawl-Rate |

| URL | Gecrawlte Seiten vs. Prioritäten |

| IP & Reverse DNS | Überprüfung echter Bots |

Wie erkenne und validiere ich den Google Bot?

Bei der Logfile-Analyse für SEO ist es essenziell, zwischen echten Google-Bot-Zugriffen und gefälschtem Crawler Traffic zu unterscheiden. Viele Bots geben sich im User Agent als „Google Bot“ aus, um Zutritt zu erhalten oder das Crawling-Verhalten zu verschleiern. Eine falsche Interpretation der Logfiles kann zu Fehleinschätzungen in deiner SEO-Strategie führen.

Warum ist die Verifizierung wichtig?

Fake Bots verursachen unnötige Serverlast

Verzerrte Daten führen zu falschen SEO-Maßnahmen

Sicherheitsaspekte (Scraper, Angreifer)

Nur echte Google-Bot-Zugriffe sind SEO-relevant

Die korrekte Identifikation des Google Bots ist zentral für jede Logfile-Analyse im SEO. Nur so kannst du fundierte Aussagen treffen. Verlasse dich niemals nur auf den User Agent. Nutze Reverse und Forward DNS Lookups, um deine Datenqualität sicherzustellen.

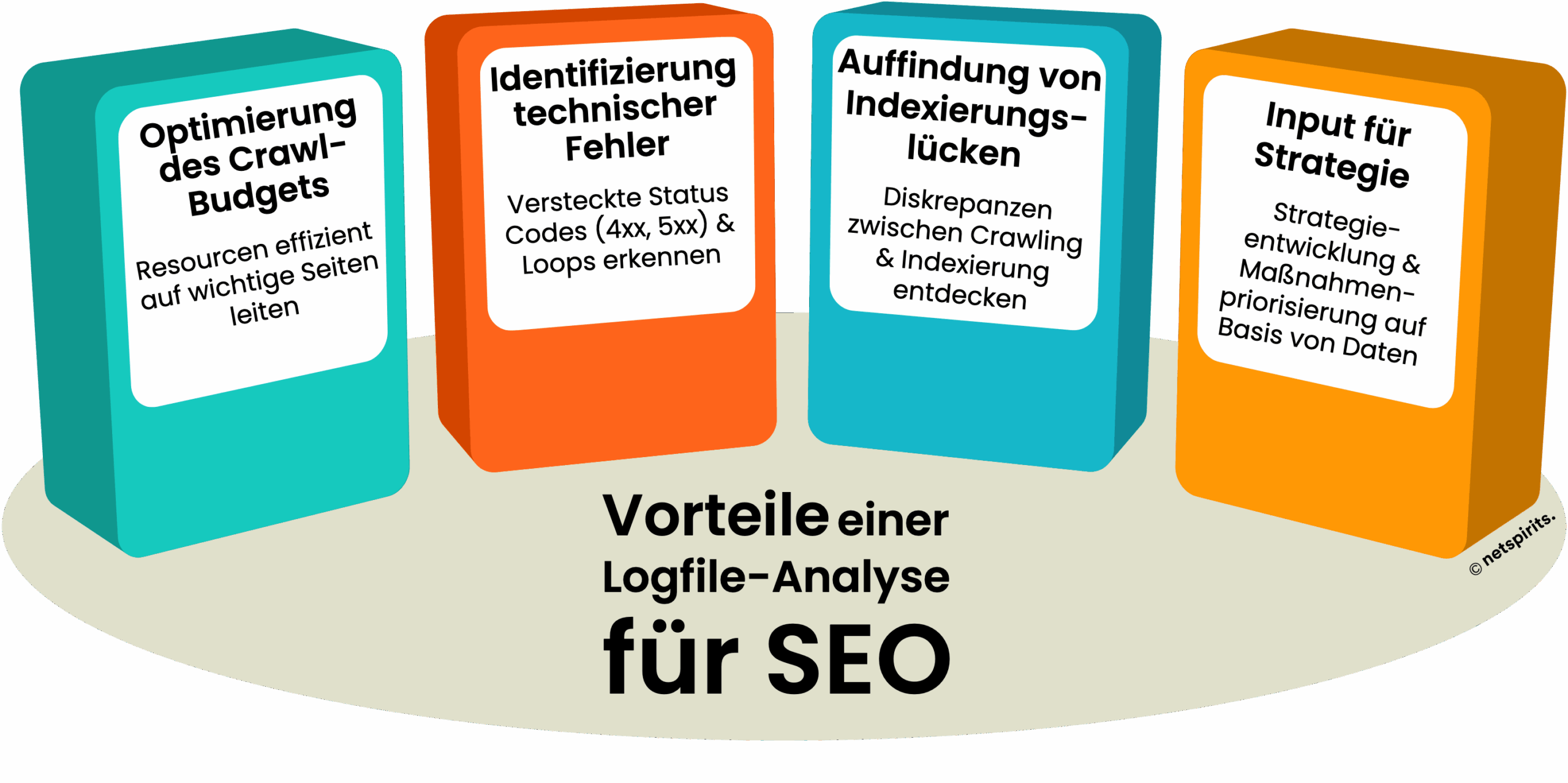

Wofür ist Logfile-Analyse im SEO gut?

Logfile-Analyse im SEO bedeutet: Du priorisierst technische Maßnahmen danach, was Google tatsächlich gecrawlt hat – nicht nur nach Annahmen aus Crawls oder Tracking.

“Wer auf die Logfile-Analyse verzichtet, betreibt SEO im Blindflug. Während herkömmliche Crawler uns nur zeigen, wie eine Website theoretisch gecrawlt werden könnte, liefern die Server Logfiles die ungeschminkte Wahrheit darüber, was die Bots tatsächlich tun und sehen. Hier gibt es keine hochgerechneten Daten oder Vermutungen – hier sehen wir jeden einzelnen Request, jede verschwendete Crawl-Ressource und jede versteckte Bot-Falle. Gerade bei umfangreichen Plattformen und großen E-Commerce-Projekten ist die Logfile-Analyse kein bloßes ‚Nice-to-have‘, sondern das unverzichtbare Fundament, um das Crawl-Budget effizient zu steuern und technische Hebel datenbasiert anzusetzen.“

1. Crawl-Budget optimieren

Google crawlt nicht unendlich – je größer die Seite, desto wichtiger ist es, zu wissen, wie der Google Bot seine Kapazitäten verteilt. Eine Logfile-Analyse zeigt:

- Welche Seiten häufig gecrawlt werden – auch solche ohne SEO-Relevanz

- Welche Seiten kaum oder gar nicht gecrawlt werden

- Wie oft und in welchem Intervall der Google Bot bestimmte Verzeichnisse besucht

Daraus lassen sich konkrete Maßnahmen ableiten wie etwa das Einschränken des Crawlings SEO-irrelevanter Verzeichnisse über die robots.txt, den Ausschluß einzelner Seiten von der Indexierung per noindex-Tag auf Seitenebene oder das gezielte Stärken wichtiger Seiten durch eine verbesserte interne Verlinkung.

2. Technische Fehler aufdecken

Durch die Auswertung der HTTP Status Codes in den Logfiles erkennst du schnell, wo der Google Bot auf Probleme stößt:

- Häufige 4xx-Fehler (Seite nicht gefunden)

- 500er-Fehler (Serverprobleme)

- Weiterleitungsketten oder endlose Redirects

- Crawling von URL-Varianten mit Parametern

Diese technischen Stolpersteine kosten nicht nur Crawl-Budget, sondern können sich auch negativ auf die Indexierung und Nutzererfahrung auswirken.

Logfiles sind nicht nur dafür da, „den einen Fehler“ zu finden. Sie sind vor allem stark darin, wiederkehrende Muster aufzudecken, die du in manuellen Crawls, der Google Search Console oder anderen Tools oft nicht (oder erst sehr spät) bemerkst, weil sie zeitabhängig, bot-spezifisch oder durch Infrastrukturregeln ausgelöst werden.

3. Indexierungsprobleme erkennen

Nicht alles, was gecrawlt wird, wird auch indexiert – und umgekehrt. Die Kombination aus Logfile-Analyse und Index-Abgleich (z. B. via Google Search Console) zeigt:

- URLs, die Google häufig crawlt, aber nicht im Index hat

- URLs, die im Index sind, aber selten oder gar nicht gecrawlt werden

- Duplicate Content-Probleme, die sich in auffälligem Crawl-Verhalten widerspiegeln

Ein typischer Fund beim Logfiles analysieren sind Orphan Pages: Seiten, die von Bots gecrawlt werden (zum Beispiel über Sitemaps, externe/alte Links oder Parameter), aber internen nicht verlinkt sind..

Diese Erkenntnisse helfen dabei, gezielt inhaltliche oder technische Anpassungen vorzunehmen.

4. SEO-Maßnahmen priorisieren

Die Logfile-Analyse unterstützt bei der strategischen Entscheidungsfindung: Welche Bereiche der Website sollte man zuerst optimieren? Wo ist der Google Bot bereits aktiv, wo nicht?

Beispiele:

- Wenn Google wichtige Seiten kaum besucht → interne Verlinkung verstärken

- Wenn unwichtige Filter- oder Archivseiten stark gecrawlt werden → Crawl-Steuerung verbessern

- Wenn viele 3xx/4xx/5xx-Statuscodes im Crawl auftauchen → Weiterleitungen und Fehlerseiten bereinigen, Server-Stabilität & Redirect-Logik optimieren

- Wenn der Google Bot regelmäßig sehr lange Antwortzeiten (hohe TTFB) sieht → Performance priorisieren, damit Crawling effizienter läuft und Seiten schneller neu verarbeitet werden

So lässt sich SEO nicht mehr nur „aus dem Bauchgefühl“, sondern basierend auf realem Crawler-Verhalten steuern.

Wichtig: Logfiles bieten ausschließlich Daten zu technischen Zugriffen – sie sagen nichts über Nutzerverhalten auf der Seite aus (z. B. Scrolltiefe, Verweildauer, Conversions). Wer Nutzerinteraktionen auswerten will, sollte ergänzend Tools wie Google Analytics oder Microsoft Clarity nutzen. Die Kombination aus Client- und Serverdaten bietet den Blick

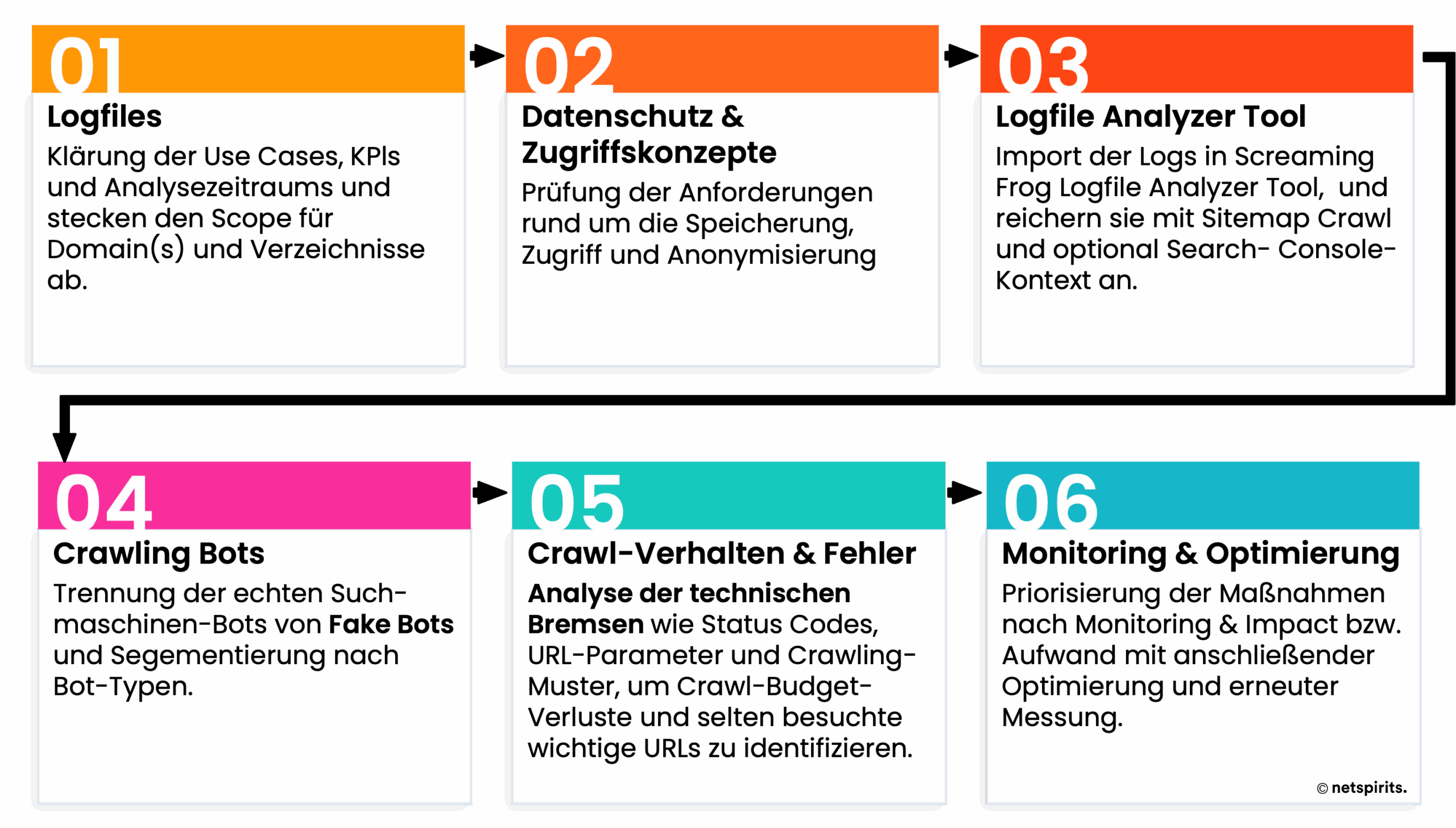

Praxis: Wann und wie wir Logfile-Analysen in der SEO durchführen

In unserer Agentur setzen wir die Analyse von Logfiles als Teil der technischen SEO-Betreuung ein. Unser Ziel: Transparenz über das tatsächliche Crawling-Verhalten schaffen und daraus klare Handlungsempfehlungen ableiten.

Wie häufig sollte man Logfile-Analysen durchführen?

Für die Logfile-Auswertung hat sich eine regelmäßige Betrachtung bewährt – im Idealfall quartalsweise. In der Praxis hängt der genaue Rhythmus vom Datenvolumen und den individuellen Gegebenheiten ab. Gerade bei großen, stark frequentierten Websites sorgt eine kürzere Taktung dafür, dass die Daten übersichtlich aufbereitet werden können und Erkenntnisse schneller nutzbar sind.

Quartalsweise Analysen bieten folgende Vorteile:

Regelmäßige Vergleichbarkeit über Zeiträume hinweg

Frühzeitige Erkennung von Veränderungen (z. B. durch Relaunches, neue Seitentypen)

Weniger Datenchaos – dafür fokussierte Auswertung und klare Priorisierung

Frühzeitige Erkennung von Veränderungen (z. B. durch Relaunches, neue Seitentypen)

Weniger Datenchaos – dafür fokussierte Auswertung und klare Priorisierung

So behalten wir die Kontrolle über das Crawl-Verhalten und können proaktiv handeln.

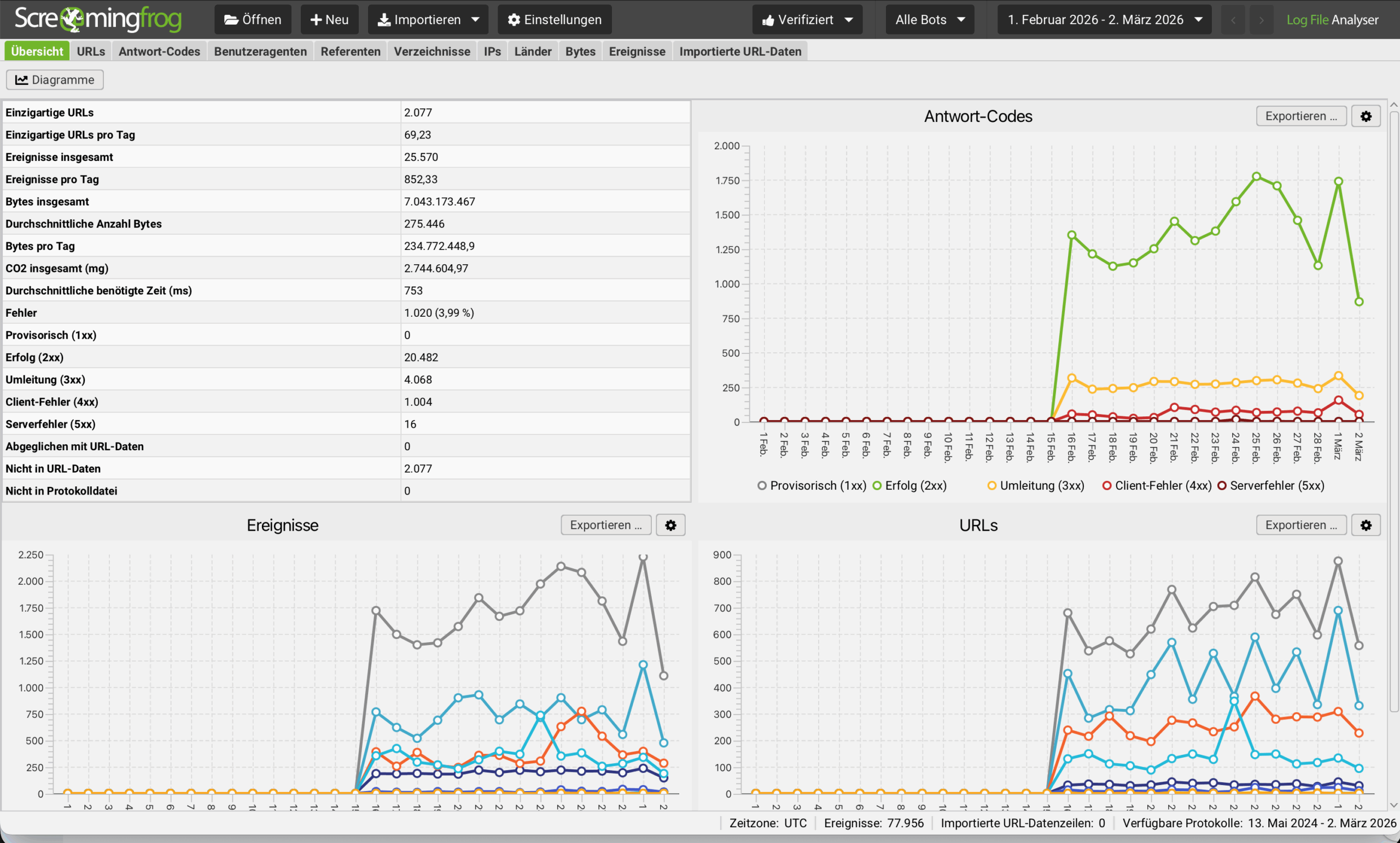

Das Tool unserer Wahl: Screaming Frog Log File Analyzer

Für die operative Umsetzung nutzen wir das Logfile-Analyse Tool Screaming Frog Log File Analyser – ein spezialisiertes Tool für die Logfile-Auswertung, das besonders im SEO-Kontext leistungsstark ist.

Vorteile des Tools im Agenturalltag:

Import großer Mengen an Access Logs (CSV, Apache, NGINX etc.)

Automatische Erkennung und Verifizierung von Google-Bot-Zugriffen

Filterung nach HTTP-Statuscodes, Crawler-Typen, URL-Pfaden u. v. m.

Verknüpfung mit XML-Sitemaps, Crawl-Daten und URL-Listen (z. B. aus Screaming Frog SEO Spider)

Export von Berichten für Reporting und strategische Ableitungen

Unser Tipp: Wir kombinieren das Tool häufig mit ergänzenden Datenquellen wie der Google Search Console, um Indexierungsverhalten und Crawling einander gegenüberzustellen.

Wie integriere ich die Logfile-Analyse in meine SEO-Strategie

Die Logfile-Analyse ist weit mehr als ein technischer Blick in die Serverdaten – sie ist ein zentraler Bestandteil einer fundierten SEO-Strategie. Sie liefert präzise Antworten auf Fragen, die weder klassische Webanalyse-Tools noch Keyword-Rankings beantworten können: Wie und wann interagieren Suchmaschinen tatsächlich mit meiner Website? Welche Seiten erhalten Sichtbarkeit im Crawl, welche werden ignoriert?

Durch die Auswertung von Access Logs lassen sich Crawl-Budget, Indexierungsverhalten und technische Fehler sichtbar machen – und vor allem: gezielt beeinflussen.

Gerade bei größeren Websites mit vielen URLs entstehen dadurch echte Optimierungspotenziale.

Kurz gesagt: Wer die Logfiles seiner Website ignoriert, verschenkt wertvolle Informationen – und damit SEO-Potenziale. Wer sie regelmäßig analysiert, schafft die Basis für nachhaltige Sichtbarkeit und technische Exzellenz.

Wenn du willst, unterstützen wir dich dabei herauszufinden, ob und wo eine Logfile-Analyse für deine Domain sinnvoll ist. Zum Beispiel mit einem kurzen Setup-Check, der Einordnung von Googlebot-Zugriffen und ersten Quick-Win-Hinweisen. Kontaktiere uns gerne. Wir sagen dir transparent, wo sich der Aufwand lohnt.

Wenn du danach eine vollständige Logfile-Analyse möchtest, setzen wir sie gerne nach Beauftragung für dich um.

FAQ: Häufige Fragen zur Logfile-Analyse

Was ist eine Logfile-Analyse?

Eine Logfile-Analyse ist die Auswertung von Server-Logfiles (meist Access Logs), um das tatsächliche Zugriffs- und Crawl-Verhalten auf deiner Website zu verstehen. Du siehst dabei konkret, welche URLs von Crawling-Bots (z. B. Suchmaschinen-Bots und KI-Crawlern) und von Nutzenden angefragt wurden – inklusive Zeitpunkt, Statuscode, User-Agent und oft IP/Host. Der Vorteil gegenüber Analytics: Logfiles sind „roh“ und unabhängig von Tracking-Skripten. Typische SEO-Insights sind:

- Welche Seiten werden wirklich gecrawlt und wie häufig?

- Wo geht Crawl-Budget durch Fehler, Redirect-Ketten oder Parameter-URLs verloren?

- Wo treten technische Probleme auf, die Bots am effizienten Crawling hindern (4xx/5xx, Timeouts, langsame Antworten)?

Wie oft sollte man Logfiles auswerten?

Die richtige Frequenz hängt von URL-Menge, Änderungsrate und technischer Komplexität ab. Als Faustregel: Je größer und dynamischer die Website, desto kürzer der Analyse-Rhythmus. Bewährt hat sich:

- Große Shops/Portale (viele URLs, tägliche Änderungen): monatlich oder als Monitoring.

- Mittelgroße Websites (regelmäßige Releases): quartalsweise.

- Kleine, stabile Websites: 1–2× pro Jahr.

Zusätzlich solltest du Logfiles immer dann auswerten, wenn sich „Crawl-Signale“ verändern: nach Relaunch/Migration, bei auffälligen Indexierungsproblemen, stark steigenden 4xx/5xx, neuen URL-Typen (Filter/Parameter) oder wenn Bot-Traffic/Serverlast plötzlich anzieht. Idealer Vergleich: 30 Tage vor vs. 30 Tage nach einem großen Change.

Welche Logfiles brauche ich für SEO?

Für SEO reichen in den meisten Fällen Access Logs, weil sie pro Request die wichtigsten Felder enthalten (URL, Statuscode, Zeitpunkt, User-Agent, oft IP/Host) und damit Crawl-Waste, Fehler und Prioritäten sichtbar machen. Ergänzend sind Error Logs hilfreich, wenn du Ursachen für 5xx/Timeouts und Serverinstabilität sauber eingrenzen willst. Wenn ein CDN/Proxy (z. B. Cloudflare) vorgeschaltet ist, brauchst du idealerweise auch dessen Logs – sonst fehlt dir ein Teil der Bot- und Nutzerzugriffe. Als pragmatischer Start funktionieren 30–60 Tage Access Logs sehr gut; bei großen Sites sind 60–90 Tage oft noch aussagekräftiger (Saisonalität, Release-Zyklen).

Wichtig: Rohdaten (unaggregiert) und konsistente Zeitzone, damit du Crawl-Fenster und Peaks korrekt interpretierst.

Woran erkenne ich den Google Bot in den Logs?

Crawling-Bots erkennst du in der Praxis zuerst über den User-Agent (z. B. „Googlebot“, „Bingbot“ oder KI-Crawler). Weil User-Agents leicht gefälscht werden können, ist für belastbare Auswertungen (Security/Last/Monitoring) eine Verifizierung sinnvoll:

1) User-Agent filtern (Bot-Name + Varianten).

2) Reverse DNS der IP prüfen (Hostnamen-Auflösung).

3) Forward Lookup: Den Hostnamen wieder zur IP auflösen und matchen.

4) Optional: Abgleich mit veröffentlichten IP-Ranges/ASN des Anbieters, falls verfügbar.

So trennst du echte Bots von Spoofing-Traffic und vermeidest, dass Fake-Bots deine Crawl-Auswertung und Prioritäten verfälschen.

Welche Statuscodes sind wirklich kritisch?

Kritisch sind Statuscodes immer dann, wenn sie häufig auftreten oder wichtige URL-Typen betreffen – und zwar unabhängig davon, welcher Bot crawlt. Priorität haben:

- 5xx/Timeouts/429: Signalisieren Serverprobleme oder Rate-Limits und können dazu führen, dass Bots das Crawling drosseln.

- 404/410 auf relevanten URLs: Kostet Crawl-Budget und ist oft ein Hinweis auf kaputte interne Links, veraltete Sitemaps oder fehlerhafte Redirect-Logik.

- 3xx-Ketten (301/302 in Serie): Verlängern den Crawl-Weg, erhöhen Latenz und „verbrauchen“ Crawl-Ressourcen.

- 200 auf „falschen“ URL-Varianten (Parameter, Duplikate): Technisch ok, SEO-seitig oft Crawl-Waste – hier helfen Regeln (Canonical, Parameter-Handling, interne Verlinkung, robots/noindex je nach Fall).

Der wichtigste Blick ist nicht „ein Code“, sondern das Muster: Welche Bots treffen auf welche Codes, wie oft, und an welchen Seitentypen?